Memory Supercycle : Mini-Resumen para entender por qué las acciones de semiconductores coreanas están volando

TLDR: El boom de IA no solo necesita capacidad de procesamiento (GPUs), sino también memoria que permita entrenar a los modelos y almacenar el caché de las conversaciones del usuario. Esta demanda creó una escasez global de chips de memoria, cuya manufactura está concentrada en muy pocas empresas, en su mayoría coreanas.

1. Contexto : Crecimiento exponencial de cómputo

Durante los primeros años de disponibilidad masiva de LLMs (2022-2024), el principal problema estaba en el entrenamiento de los modelos y en el procesamiento de los prompts. La demanda en velocidad y capacidad de cómputo creció exponencialmente, llevando a $NVDA a subir de forma vertical. Sin embargo, a medida que los datasets para entrenar crecieron de forma masiva, los modelos necesitaban acceder a datos cada vez más grandes cada vez más rápido. Los GPUs de NVIDIA empezaban a no dar abasto para leer estos datos por problemas de memoria.

¿Por qué la memoria se volvió un bottleneck?

- El entrenamiento de un modelo necesita cargar datasets gigantes para procesarlos una y otra vez de forma rápida. El crecimiento de los datasets implica más memoria.

- La memoria implícita que consume cada conversación de los usuarios: cada modelo Transformer genera tokens uno a la vez. De forma simplificada, para generar un nuevo token, el modelo tiene que "tener en cuenta" a todos los tokens anteriores. Para evitar recalcular todas las relaciones entre tokens, se utiliza el concepto de KV Cache, que transforma cada token en 3 vectores. Pensemos que hoy por hoy, los modelos más populares llegan a tener Context Windows de hasta 1 millón de tokens. Dependiendo del modelo, de su cantidad de capas, de sus dimensiones internas, etc., la cantidad de memoria que el servidor tiene que consumir puede volverse astronómica.

A medida que las LLMs son más usadas y se crean más sets de datos para entrenarlas, se crea un ciclo virtuoso (o vicioso, según cómo se mire) de consumo de procesamiento y memoria.

2. Guía minimalista de los tipos de memoria actuales

2.1 DRAM Convencional (DDR5)

DRAM (Dynamic Random-Access Memory) es la memoria RAM clásica que usamos en cualquier computadora, sean nuestras shitbox Lenovo Thinkpads laborales o un servidor en un datacenter. Es una memoria volátil: si cortamos la energía, se borra la información. Su estructura es simple: un capacitor y un transistor por celda, modificados por un controlador de memoria que cambia el estado de cada celda. Se comunica con el mother por un bus en el PCB, es decir, mediante pistas de cobre de hasta centímetros de longitud. A frecuencias altas, esto trae bastantes problemas electromagnéticos, por lo que se limita el ancho del bus de datos. Los forros de Micron $MU anunciaron que iban a dejar de vender este segmento a retail, aunque sí van a seguir proveyéndolo a third parties para que fabriquen DRAM para el público minorista.

2.2 HBM (High Bandwidth Memory): Shiny better toy

Si bien la capacidad de cómputo creció exponencialmente en los últimos años, la velocidad de las memorias no aumentó al mismo nivel. Esta brecha, conocida como Memory Wall, hace que los GPUs estén cada vez más tiempo esperando datos en vez de procesarlos. Para intentar solucionar este problema se crearon las memorias HBM.

En vez de colocar chips de memoria uno al lado del otro como en un PCB, se comenzaron a stackear verticalmente. Actualmente se apilan entre 8 y 12 capas, buscando llegar a 16+ dentro de poco (cada capa mide μm). Las capas se comunican verticalmente mediante conexiones TSV (Through Silicon Via) que son perforaciones microscópicas en el silicio rellenas de cobre. Las comunicaciones TSV permiten intercomunicar las distintas capas de memoria. Un stack de HBM tiene miles de conexiones TSV permitiendo aumentar el tamaño de bus de datos, de 64 bits en DDR, a 1024 bits en HBM3 y 2048 bits en HBM4.

Además, los stacks de memoria se colocan al lado del GPU mediante un sustrato de silicio llamado Interposer, que hace que los datos viajen muchísima menor distancia hacia el procesador comparado con DDR.

HBM4 : El salto generacional

HBM4 fue el salto más grande entre generaciones de memoria apilada. No solo es más rápida sino que cambió la arquitectura:

- Duplica el ancho de interfaz de 1024 a 2048 bits.

- Introduce el logic base die: la capa inferior de la torre se reemplaza por un chip lógico. Esto permite integrar controladores de memoria, lógica de prueba y funciones personalizadas por el cliente directamente dentro del stack de memoria. Difumina la línea entre memoria y procesador.

2.3 LPDDR6 : Low power para cosas móviles

LPDDR (Low-Power DDR) es una variante de DRAM optimizada para minimizar el consumo de energía, sobre todo para celulares y tablets en donde la batería es un limitante crítico. Mediante optimizaciones en los semiconductores, permite un consumo bastante más bajo aunque resignando performance. Si bien es un mercado más de nicho, son esenciales para cualquier dispositivo que requiera correr algún modelo de IA de forma local.

2.4 NAND Flash : No volátil, víctima?

Las NAND son memorias NO VOLÁTILES que usan los discos SSDs para almacenar datos de forma permanente. Las memorias NAND utilizan otro tipo de transistores para sus celdas de almacenamiento, conocidos como floating-gate transistors. Sin entrar en detalle de la estructura de semiconductores, este tipo de memoria permite tener más capacidad por chip (lo que baja el costo) pero con peor velocidad y durabilidad. Al igual que las memorias HBM, las NAND mejoraron su performance apilando chips.

El problema principal con las memorias NAND es medio tautológico:

- Los principales fabricantes redirigieron su producción hacia HBM y DDR para IA, que les daban márgenes mucho más altos. Cada wafer que se usa para HBM es uno menos que se usa para NAND.

- Antes del boom de la IA, el costo de este tipo de memorias fue bajando rápidamente, tanto que los productores recortaron su producción para frenar la caída de precios. Cuando la demanda explotó, simplemente no existía la capacidad para producir ambas memorias a la vez.

2.5 Esquema de Jerarquía: Cómo Trabajan Juntas

En un data center de IA moderno, los cuatro tipos de memoria trabajan en cascada, cada uno con un rol específico:

┌─────────────────────────────────────────────────────────┐

│ GPU │

│ ┌─────────────────┐ │

│ │ HBM4 │ ← Pesos del modelo + KV cache │

│ │ 288 GB │ "hot" (los más accedidos) │

│ │ 22 TB/s │ Ancho de banda: máximo │

│ └─────────────────┘ │

│ ↕ overflow │

│ ┌─────────────────┐ │

│ │ DRAM (DDR5) │ ← KV cache "warm" + buffers │

│ │ 1-2 TB │ de datos en tránsito │

│ │ ~200 GB/s │ 10-50x más lento que HBM │

│ └─────────────────┘ │

│ ↕ overflow │

│ ┌─────────────────┐ │

│ │ NVMe SSD │ ← KV cache "cold" + datasets │

│ │ (NAND Flash) │ + checkpoints + datos │

│ │ 10-100 TB │ generados por IA │

│ │ ~14 GB/s │ 100-1000x más lento que HBM │

│ └─────────────────┘ │

│ │

│ LPDDR6 → Usado en nodos edge / inferencia eficiente │

│ donde el consumo de energía es prioritario │

└─────────────────────────────────────────────────────────┘

Esta cascada explica por qué la demanda de IA impacta TODA la cadena de memoria simultáneamente: más usuarios → más KV cache → más HBM necesaria → overflow a DRAM → overflow a SSDs (NAND). La escasez en cualquier nivel crea un cuello de botella que frena todo el sistema.

3. Los jugadores: Quién hace qué y cómo invertir

Mi suposición es que no escuchamos tanto de este superciclo en esta parte del mundo porque no son empresas que se puedan comprar fácilmente ($NVDA tenía CEDEAR desde hace mil millones de años). Por eso voy a pasar un mini resumen de cuál es el rol de cada empresa y cómo poder comprarla.

3.1. El Big Three de las memorias

La industria de las memorias está principalmente concentrada en 3 empresas.

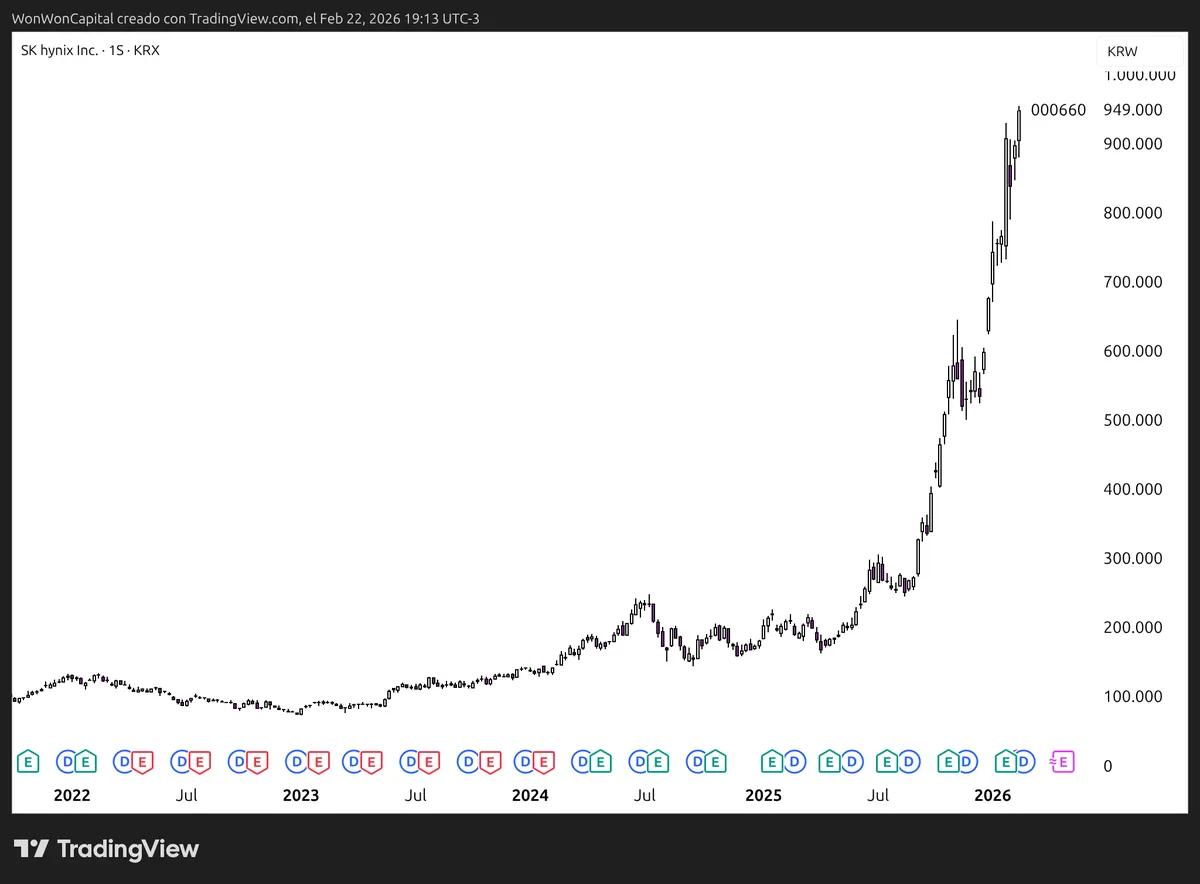

SK HYNIX (🇰🇷): El rey

- Market share HBM: ~57% (Q3 2025). Principal proveedor MUNDIAL de memorias HBM.

- Proveedor principal de NVIDIA para HBM3e y HBM4

- Capacidad 2026: Completamente vendida. Toda su producción de HBM está reservada

- Market Cap : 655.24T KRW (453B USD). Es la empresa 23 (!!!!!) más grande del mundo por market cap.

- Rendimiento Y/Y : +370% Es seguramente la mayor empresa de la que nunca escuchamos. Actualmente no tiene ni ADR ni CEDEAR. Sí posee equivalente en la bolsa de Londres (se puede comprar en los mercados europeos).

Samsung Electronics (🇰🇷): Sí, ese Samsung!

- Market share HBM: ~22% (Q3 2025), subiendo desde 15% en Q2

- Diferenciador: Adoptó proceso 1c-nm (6ta generación 10nm) para HBM4, una generación adelante de la competencia. Esto da 10-20% mejor eficiencia energética y +10% mayor velocidad

- Estrategia: Apunta al segmento ultra-premium de GPUs NVIDIA (Vera Rubin NVL72).

- Market Cap: 1.270T KRW (880B USD). Empresa 14 más grande del mundo por market cap.

- Rendimiento Y/Y: +240% Samsung posee una de las mayores capacidades de producción de semiconductores del mundo. Sin resignar su lugar en el mercado de dispositivos, está creciendo su capacidad para producir memorias a ritmo exponencial. Tampoco posee ADR, pero también está listada en LSE y demás mercados europeos.

Micron Technology (🇺🇸) : $MU (sí, un ticker!)

- Market share HBM: ~21% (Q3 2025)

- Logro: Muestras de HBM4 récord con 2.8 TB/s de ancho de banda a 11 Gbps

- Capacidad HBM vendida hasta 2026

- Market Cap: 481B USD : Empresa 18 del mundo en market cap.

- Rendimiento Y/Y: +330%

Única empresa americana en el top 3. El primer indicio de este ciclo de memorias fue cuando Micron anunció que iba a dejar de enfocarse en el mercado retail de memorias para ser proveedor íntegramente de empresas de IA.

3.2. Otros jugadores

Existen otras empresas ampliamente beneficiadas por este ciclo que, si bien no son productores directos de memorias HBM, tienen un rol protagónico en otros segmentos:

- Kioxia (🇯🇵): Antigua división de memorias de Toshiba. Su fuerte es proveer memorias NAND para data centers de IA. De IPO reciente, está +623% Y/Y, con un market cap de 11.194T Yen (72B USD). No tiene ADR ni está listada en ningún mercado occidental.

- SanDisk (🇺🇸 $SNDK): Principal proveedor de memorias NAND para occidente. Líder en SSDs y memorias flash, y pionero en memorias NAND. Con un market cap de 95B USD, está +1200% Y/Y (damn jfc).

- Taiwan Semiconductor Manufacturing Co. (🇹🇼 $TSM): TSMC no fabrica memoria, pero es absolutamente crítico para el ecosistema HBM por su tecnología de empaquetado avanzado CoWoS (Chip-on-Wafer-on-Substrate). Es decir, no produce memorias, pero su manufactura de semiconductores y empaquetados es esencial para la producción de HBMs. Es la 6ta empresa más grande del mundo en market cap (1.921T USD), pero eso no le impide estar +90% Y/Y.

3.3 : $EWY como proxy?

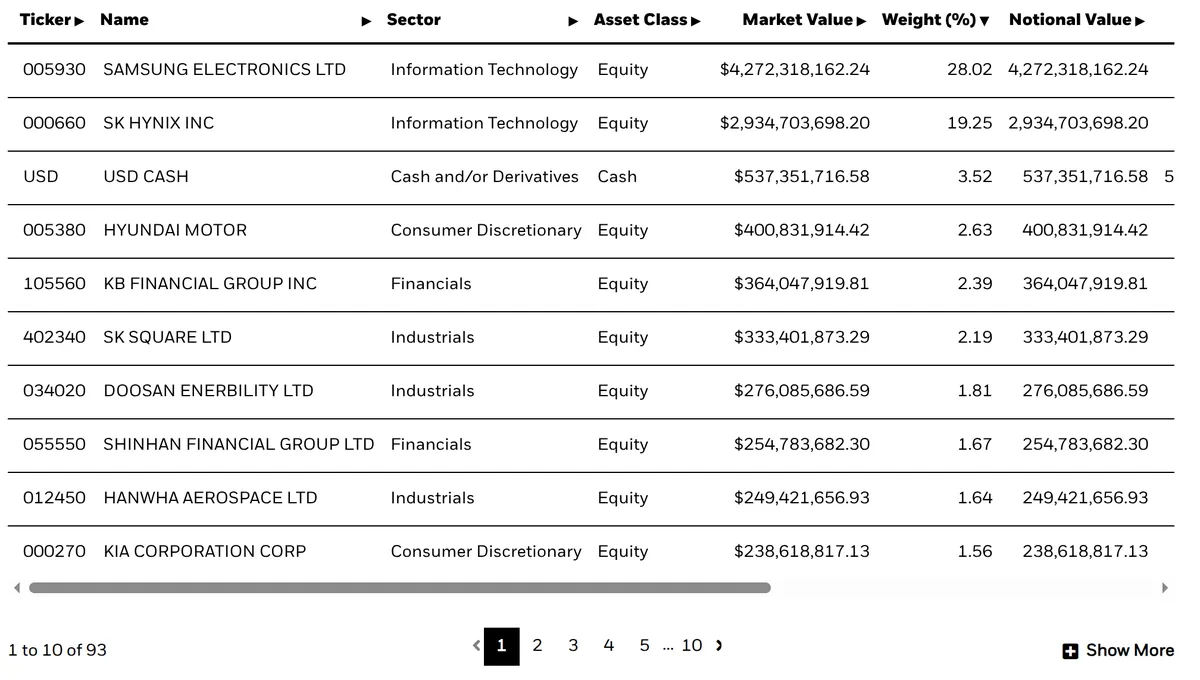

Si bien SK Hynix y Samsung no están listadas en mercados americanos, sí tenemos disponibles ETFs de Korea!

En un año en el que el KOSPI está +130% Y/Y, el $EWY trackeo ese comportamiento casi idénticamente, salvo por alguna diferencia de composición:

Lo interesante es ver la composición del $EWY:

Es decir, un 47.27% del índice es Samsung + SK Hynix! Es un excelente proxy si lo que nos interesa es invertir en este sector.

4. Conclusión

Seguro que cuando empecé a escribir la lista de empresas y viste el Market Cap de cada una, todos pensamos que llegamos tarde a este boom. Pero, supongamos un mundo en el que la "burbuja" de la IA no explota y la demanda de memoria sigue creciendo, estas empresas ya están al máximo de su capacidad y aún así les siguen demandando extra! Pensemos también que son empresas que llegaron a estas valuaciones en su mayoría sin tener un ADR en los mercados americanos. No es el punto de este artículo ponerse a analizar ratios de valuación, eso queda de tarea para el lector, pero quedaría pensar en si no pudiese haber un arbitraje entre valuaciones de empresas de oriente y occidente.

Dicho esto, este artículo es un resumen extremadamente breve. La lista de empresas beneficiadas por este superciclo es muchísimo más extensa de lo que cubrimos acá: desde proveedores de equipos de fabricación (DISCO, Hanmi Semiconductor, Tokyo Electron) hasta fabricantes de materiales críticos (NAMICS, Sumitomo Electric) y empresas de fotónica e infraestructura de data centers. Todas estas empresas van a tener sus ventajas y riesgos. Este artículo es simplemente para dar un pantallazo del mundo de las memorias.

Entonces, DYOR blablabla, la idea es simplemente acercar los mercados orientales con un primer puntazo.

5. PD: Trade Idea

SK Hynix y Samsung tradean en el mercado coreano, pero $EWY en el americano. Técnicamente se debería poder predecir en la sesión europea cuánto se debería mover el índice y tradearlo acorde.